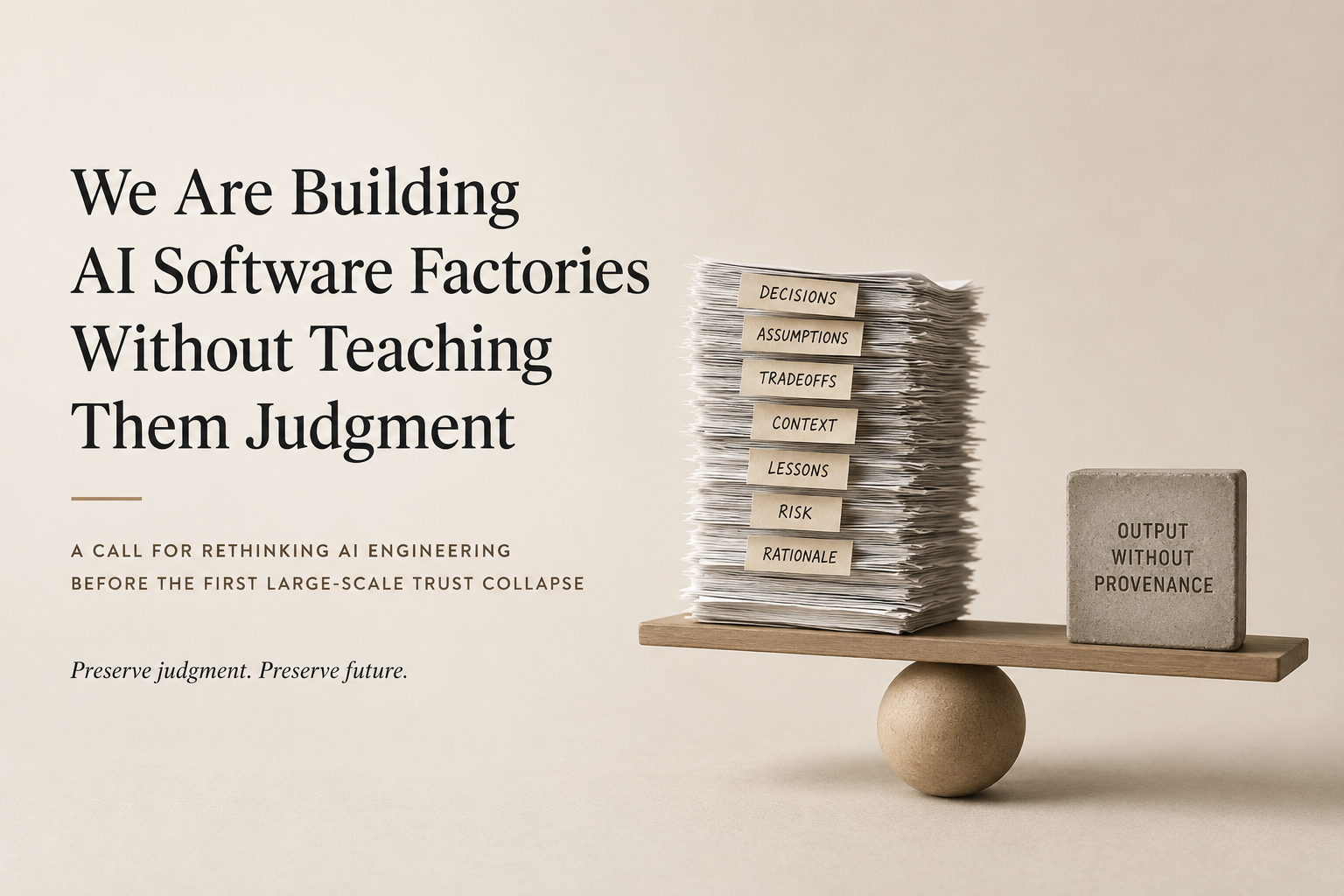

Estamos construyendo fábricas de software con IA sin enseñarles criterio

Author: Yauheni Kurbayeu

Published: May 13, 2026

LinkedIn

Un llamado a replantear la ingeniería de IA antes del primer colapso de confianza a gran escala

La industria está celebrando un hito extraño.

Por fin enseñamos a las máquinas a producir software a escala industrial.

Los sistemas de programación multiagente ahora:

- escriben funcionalidades,

- refactorizan repositorios,

- generan pruebas,

- revisan pull requests,

- migran frameworks,

- y orquestan pipelines de entrega más rápido de lo que muchos equipos imaginaron posible hace solo dos años.

Y casi nadie está haciendo la pregunta incómoda que se esconde debajo de toda esta aceleración.

¿Quién les está enseñando criterio a estos sistemas?

No sintaxis.

No orquestación.

No rendimiento en benchmarks.

Criterio.

La analogía peligrosa que nadie quiere discutir

Ahora mismo, la industria de la IA se parece cada vez más a un hospital que decidió acelerar masivamente el rendimiento de las cirugías entregando bisturíes a brillantes graduados de medicina inmediatamente después de terminar la universidad.

Los estudiantes tienen:

- calificaciones perfectas en los exámenes,

- conocimiento anatómico impecable,

- rendimiento excelente en simulaciones,

- y recuerdo completo de las mejores prácticas procedimentales.

Pero ningún hospital experimentado en el mundo les permitiría realizar una cirugía de corazón de manera independiente el primer día.

¿Por qué?

Porque la medicina entiende algo que la ingeniería de software todavía intenta ignorar:

Existe una diferencia enorme entre saber cómo ejecutar un procedimiento y saber cuándo, por qué y bajo qué condiciones ese procedimiento debe ocurrir.

Esa diferencia es criterio acumulado.

Y el criterio acumulado es, en gran medida, historia de decisiones comprimida.

La intuición clínica es procedencia comprimida

Los cirujanos experimentados no operan basándose únicamente en libros de texto.

Operan a partir de:

- miles de decisiones previas,

- fracasos,

- tradeoffs,

- casi accidentes,

- complicaciones,

- adaptaciones procedimentales,

- y señales contextuales acumuladas a lo largo de años.

Lo que la medicina llama intuición clínica suele ser procedencia de decisiones altamente comprimida.

Una especie de instinto virtual construido a partir de decisiones preservadas.

Sin embargo, en la ingeniería de software, especialmente en la era de la IA, estamos industrializando la ejecución mientras ignoramos casi por completo la preservación del propio criterio.

La industria está obsesionada con la aceleración visible

La conversación actual sobre IA está dominada por:

- agentes autónomos,

- fábricas de software,

- frameworks de orquestación,

- capacidades de modelos,

- ganancias de productividad,

- velocidad de programación,

- y reducción de costes.

Pero se está prestando muy poca atención a la capa invisible que existe debajo del resultado:

- por qué se tomaron decisiones,

- qué supuestos las moldearon,

- qué tradeoffs se aceptaron,

- qué alternativas se rechazaron,

- si el razonamiento original sigue siendo válido,

- y cómo los sistemas futuros heredan esas decisiones de forma segura.

Esta omisión se está volviendo peligrosa.

La memoria organizacional está desapareciendo silenciosamente

Cuanto más capaces se vuelven los sistemas de IA, más empieza la memoria organizacional a desaparecer silenciosamente detrás de los resultados generados.

El problema es sutil al principio.

Un agente de IA introduce una solución temporal porque “el código funciona”.

Más tarde, otro agente optimiza en torno a esa solución temporal sin entender su restricción original.

Meses después, un tercer sistema trata la solución temporal como si fuera una verdad arquitectónica.

Finalmente nadie recuerda:

- si el comportamiento era intencional,

- si el tradeoff era temporal,

- si la política cambió,

- si el riesgo original sigue existiendo,

- o si todo el razonamiento caducó hace mucho tiempo.

El sistema sigue funcionando.

Pero el linaje del criterio ha desaparecido.

Y una vez que ese linaje desaparece, las organizaciones empiezan a operar sobre decisiones heredadas que ya no pueden explicar.

La mayor parte del criterio de ingeniería se hereda, no se vuelve a calcular

Esta es la parte que muchas discusiones actuales sobre IA subestiman de manera peligrosa.

La gente asume que sistemas de IA suficientemente avanzados simplemente “volverán a razonar todo desde cero”.

Pero los ingenieros senior saben que los sistemas reales no funcionan así.

Las organizaciones operan sobre contexto histórico comprimido:

- incidentes pasados,

- cicatrices de producción,

- restricciones operativas,

- compromisos regulatorios,

- migraciones fallidas,

- lecciones de escalado,

- realidades políticas,

- y memoria institucional.

La mayor parte del criterio de ingeniería se hereda, no se vuelve a calcular.

Lo que casualmente llamamos “instinto” suele ser años de procedencia de decisiones no resuelta comprimida en intuición.

La medicina ya resolvió este problema a nivel cultural

La medicina escala la experiencia a través de:

- práctica supervisada,

- revisión por pares,

- historiales de casos,

- memoria institucional,

- linaje procedimental,

- límites de admisibilidad,

- y estructuras de responsabilidad.

No escala fingiendo que la intuición es innecesaria.

Mientras tanto, la ingeniería de software se comporta cada vez más como si la ejecución por sí sola fuera suficiente.

Como si:

- generar resultados que parecen correctos garantizara un razonamiento correcto,

- la optimización local produjera automáticamente sistemas globalmente coherentes,

- y la memoria organizacional pudiera evaporarse con seguridad porque la siguiente iteración del modelo “lo resolverá”.

Estamos escalando ingeniería junior

Las fábricas de software sin criterio preservado no son ingeniería senior a escala.

Son ingeniería junior a escala.

Ingeniería junior rápida.

Ingeniería junior industrializada.

Y el peligro de la ingeniería junior no es que siempre falle de inmediato.

El peligro es que tenga éxito con confianza justo hasta que los errores invisibles acumulados se vuelvan sistémicos.

Por qué la procedencia de decisiones importa ahora

La procedencia de decisiones no es:

- teatro de gobernanza corporativa,

- otro dashboard de observabilidad,

- ni un ejercicio de compliance.

Es la capa que falta para que los sistemas de IA hereden criterio organizacional en lugar de heredar simplemente resultados.

Porque la verdadera pregunta de la era de la IA ya no es:

“¿Pueden las máquinas generar software?”

Esa pregunta ya se está respondiendo.

La verdadera pregunta es:

“¿Cómo preservamos y transferimos el criterio de ingeniería una vez que generar software se vuelve barato?”

¿Cómo garantizamos que los agentes del futuro hereden no solo qué se construyó, sino por qué se construyó de esa manera?

¿Cómo preservamos los tradeoffs antes de que se disuelvan en código generado?

¿Cómo evitamos que las organizaciones se conviertan en sistemas amnésicos operados por motores de ejecución cada vez más capaces?

Y quizá lo más importante:

“¿Cómo construimos un instinto virtual sin convertir los sistemas de IA en máquinas opacas de superstición?”

La industria aún está demasiado temprano para ver el riesgo

El desafío es que las conversaciones sobre gobernanza rara vez se vuelven convencionales durante la fase de expansión de una ola tecnológica.

Se vuelven convencionales después del primer colapso de confianza a gran escala.

Después del primer desastre evitable.

Después del primer fallo de razonamiento invisible con consecuencias visibles.

La realidad incómoda es que la industria de la IA se está preparando actualmente para montar quirófanos a escala industrial mientras apenas discute cómo el propio criterio quirúrgico sobrevivirá a la automatización.

Y para cuando los primeros grandes fracasos obliguen a abrir la conversación, es posible que los sistemas ya estén profundamente incrustados en los cimientos de cómo las organizaciones piensan, construyen, deciden y operan.

Reflexión final

El momento de preservar el criterio no es después de que la cirugía empiece a matar personas.

El momento es ahora.