Estamos enseñando a la IA a decidir. Pero estamos olvidando cómo recordar.

Author: Yauheni Kurbayeu

Published: Jan 3, 2026

LinkedIn

Hace algún tiempo escribí que “el SDLC no tiene memoria”.

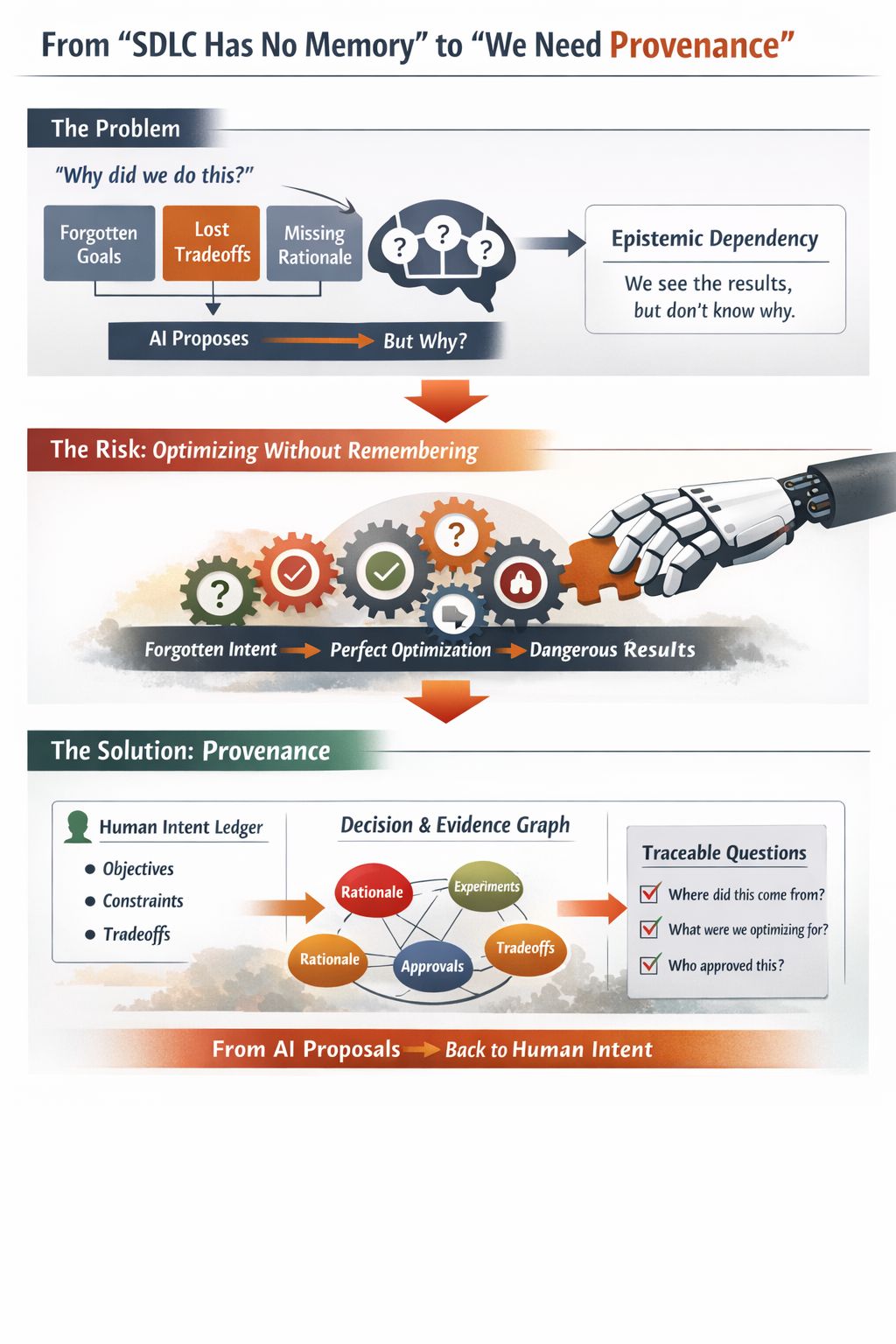

No recordamos por qué se tomaron ciertas decisiones, qué compromisos se aceptaron ni qué restricciones eran explícitas. Seis meses después, alguien pregunta: “¿Por qué lo estamos haciendo de esta manera?” Y la respuesta honesta suele ser: “En realidad ya no lo sabemos. Pero funciona.” Hasta hace poco, esto era “solo” un problema de entrega.

Ahora se está convirtiendo en un problema de seguridad de la IA.

Estamos empezando a permitir que la IA:

- proponga arquitecturas

- optimice planes

- explore espacios de soluciones que los humanos no pueden razonar completamente

Y lentamente estamos pasando:

- de: “Entendemos por qué esta es la solución.”

- a: “El sistema encontró esto. Las métricas se ven bien.”

Eso crea una brecha de comprensión: vemos los resultados, pero ya no entendemos el razonamiento.

El riesgo real no es una IA malvada.

El riesgo real es: “Construiremos sistemas que optimicen perfectamente cosas que ya no recordamos haber elegido.”

No se necesita conciencia. Solo optimización, bucles de retroalimentación e intención olvidada.

Lo que falta es una nueva capa de infraestructura: Provenance.

Provenance = la capacidad de responder: “¿De dónde proviene esta decisión y qué intención humana servía?”

No es un wiki.

No es Jira.

No es Confluence.

Sino:

- Un registro de la intención humana

- Un grafo de decisiones, evidencias y compromisos

- Un rastro desde la ejecución hasta el propósito

En un mundo donde las máquinas proponen cada vez más decisiones:

La IA no debería ser el juez.

Provenance debería ser el acta judicial.

Antes de hablar de “alineación de la IA”, debemos poder demostrar:

- ¿Qué estamos intentando optimizar realmente?

- ¿Cuáles son los no-objetivos?

- ¿Qué restricciones son sagradas?

- ¿Qué compromisos se aceptaron explícitamente?

De lo contrario, obtendremos un sinsentido perfectamente optimizado.

Empezamos con un problema de entrega.

Estamos terminando con un problema de gobernanza y de seguridad a escala de civilización:

¿Cómo nos aseguramos de que todavía recordemos lo que intentamos construir cuando las máquinas empiecen a construirlo con nosotros?