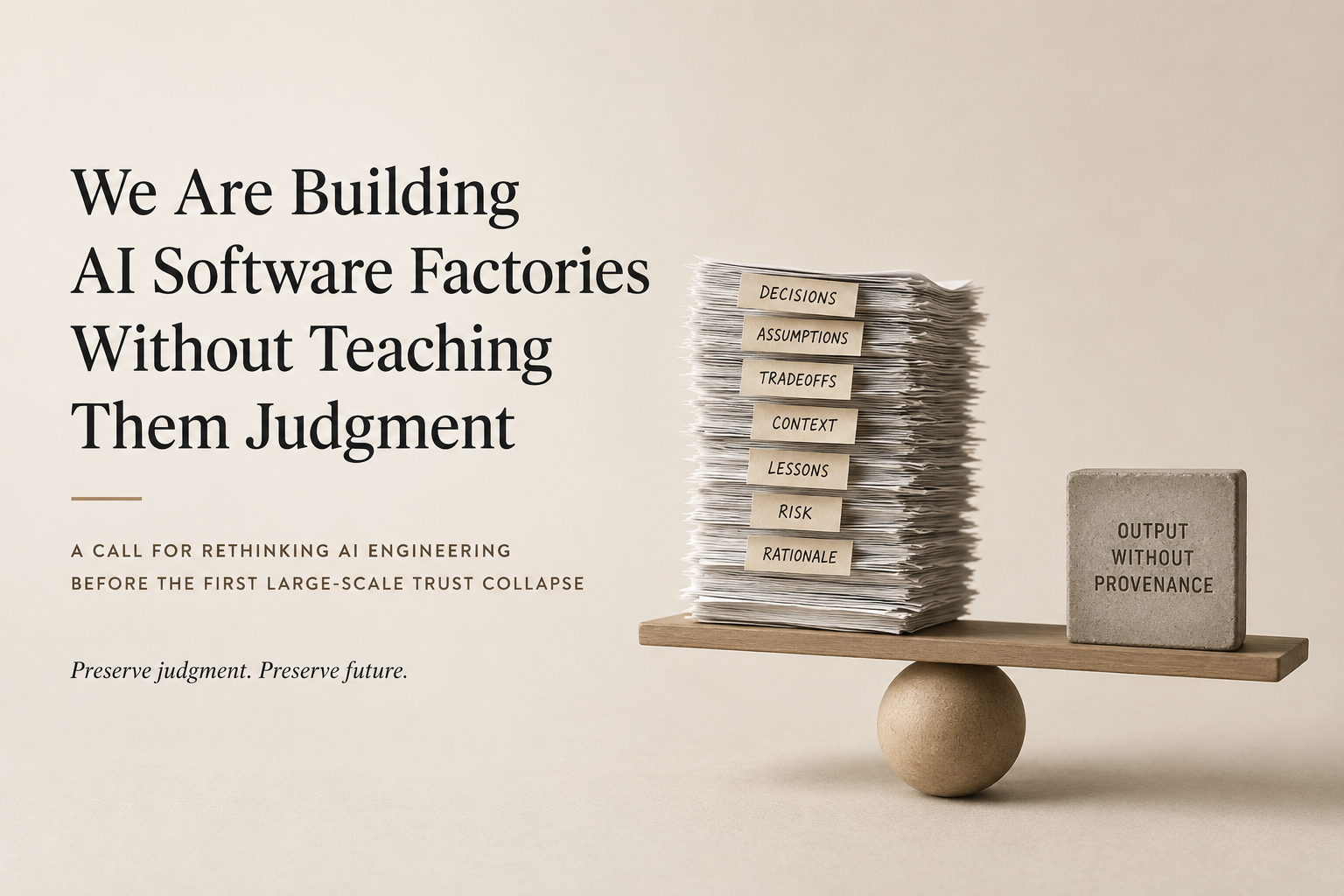

Nous construisons des usines logicielles d’IA sans leur apprendre le jugement

Author: Yauheni Kurbayeu

Published: May 13, 2026

LinkedIn

Un appel à repenser l’ingénierie de l’IA avant le premier effondrement de confiance à grande échelle

L’industrie célèbre une étape étrange.

Nous avons enfin appris aux machines à produire du logiciel à l’échelle industrielle.

Les systèmes de codage multi-agents aujourd’hui :

- écrivent des fonctionnalités,

- refactorisent des dépôts,

- génèrent des tests,

- relisent des pull requests,

- migrent des frameworks,

- et orchestrent des pipelines de livraison plus vite que beaucoup d’équipes ne l’auraient imaginé il y a à peine deux ans.

Et presque personne ne pose la question inconfortable qui se cache sous toute cette accélération.

Qui apprend le jugement à ces systèmes ?

Pas la syntaxe.

Pas l’orchestration.

Pas les performances sur benchmark.

Le jugement.

L’analogie dangereuse dont personne ne veut parler

À l’heure actuelle, l’industrie de l’IA ressemble de plus en plus à un hôpital qui aurait décidé d’accélérer massivement le débit des chirurgies en confiant des scalpels à de brillants diplômés en médecine immédiatement après leur sortie de l’université.

Ces étudiants ont :

- des résultats d’examen parfaits,

- une connaissance anatomique irréprochable,

- d’excellentes performances en simulation,

- et une mémorisation complète des meilleures pratiques procédurales.

Mais aucun hôpital expérimenté au monde ne les laisserait pratiquer une chirurgie cardiaque de manière indépendante dès le premier jour.

Pourquoi ?

Parce que la médecine comprend quelque chose que l’ingénierie logicielle essaie encore d’ignorer :

Il existe une différence immense entre savoir exécuter une procédure et savoir quand, pourquoi et dans quelles conditions cette procédure doit avoir lieu.

Cette différence, c’est le jugement accumulé.

Et le jugement accumulé est, en grande partie, une histoire des décisions compressée.

L’intuition clinique est une provenance compressée

Les chirurgiens expérimentés n’opèrent pas uniquement à partir de manuels.

Ils opèrent à partir de :

- milliers de décisions antérieures,

- échecs,

- compromis,

- incidents évités de justesse,

- complications,

- adaptations procédurales,

- et signaux contextuels accumulés au fil des années.

Ce que la médecine appelle l’intuition clinique est souvent une provenance des décisions fortement compressée.

Une intuition viscérale virtuelle construite à partir de décisions préservées.

Pourtant, dans l’ingénierie logicielle, et en particulier à l’ère de l’IA, nous industrialisons l’exécution tout en ignorant presque complètement la préservation du jugement lui-même.

L’industrie est obsédée par l’accélération visible

La conversation actuelle sur l’IA est dominée par :

- les agents autonomes,

- les usines logicielles,

- les frameworks d’orchestration,

- les capacités des modèles,

- les gains de productivité,

- la vélocité de codage,

- et la réduction des coûts.

Mais très peu d’attention est accordée à la couche invisible sous la sortie produite :

- pourquoi les décisions ont été prises,

- quelles hypothèses les ont façonnées,

- quels compromis ont été acceptés,

- quelles alternatives ont été rejetées,

- si le raisonnement d’origine est toujours valide,

- et comment les futurs systèmes héritent de ces décisions en toute sécurité.

Cette omission devient dangereuse.

La mémoire organisationnelle disparaît silencieusement

Plus les systèmes d’IA deviennent capables, plus la mémoire organisationnelle commence à disparaître silencieusement derrière les sorties générées.

Le problème est subtil au début.

Un agent d’IA introduit un contournement parce que « le code fonctionne ».

Un autre agent optimise ensuite autour de ce contournement sans comprendre la contrainte d’origine.

Des mois plus tard, un troisième système traite ce contournement comme une vérité architecturale.

Finalement, plus personne ne se souvient :

- si le comportement était intentionnel,

- si le compromis était temporaire,

- si la politique a changé,

- si le risque initial existe encore,

- ou si tout le raisonnement a expiré depuis longtemps.

Le système fonctionne toujours.

Mais la lignée du jugement a disparu.

Et une fois que cette lignée disparaît, les organisations commencent à opérer à partir de décisions héritées qu’elles ne peuvent plus expliquer.

La majeure partie du jugement d’ingénierie est héritée, pas recalculée

C’est la partie que de nombreuses discussions actuelles sur l’IA sous-estiment dangereusement.

Les gens supposent que des systèmes d’IA suffisamment avancés vont simplement « tout raisonner à nouveau depuis zéro ».

Mais les ingénieurs seniors savent que les systèmes réels ne fonctionnent pas ainsi.

Les organisations fonctionnent sur un contexte historique compressé :

- incidents passés,

- cicatrices de production,

- contraintes opérationnelles,

- compromis réglementaires,

- migrations échouées,

- leçons de mise à l’échelle,

- réalités politiques,

- et mémoire institutionnelle.

La majeure partie du jugement d’ingénierie est héritée, pas recalculée.

Ce que nous appelons avec désinvolture « l’intuition » est souvent des années de provenance décisionnelle non résolue compressées en instinct.

La médecine a déjà résolu ce problème culturellement

La médecine met l’expertise à l’échelle grâce à :

- une pratique supervisée,

- la revue par les pairs,

- les historiques de cas,

- la mémoire institutionnelle,

- la lignée procédurale,

- les frontières d’admissibilité,

- et des structures de responsabilité.

Elle ne la met pas à l’échelle en prétendant que l’intuition est inutile.

Pendant ce temps, l’ingénierie logicielle se comporte de plus en plus comme si l’exécution seule suffisait.

Comme si :

- générer des sorties qui semblent correctes garantissait un raisonnement correct,

- l’optimisation locale produisait automatiquement des systèmes globalement cohérents,

- et la mémoire organisationnelle pouvait s’évaporer sans risque parce que la prochaine itération du modèle « comprendra toute seule ».

Nous mettons l’ingénierie junior à l’échelle

Des usines logicielles sans jugement préservé ne sont pas de l’ingénierie senior à grande échelle.

Ce sont de l’ingénierie junior à grande échelle.

De l’ingénierie junior rapide.

De l’ingénierie junior industrialisée.

Et le danger de l’ingénierie junior n’est pas qu’elle échoue toujours immédiatement.

Le danger, c’est qu’elle réussit avec assurance jusqu’à ce que les erreurs invisibles accumulées deviennent systémiques.

Pourquoi la provenance des décisions compte maintenant

La provenance des décisions n’est pas :

- du théâtre de gouvernance d’entreprise,

- un tableau de bord d’observabilité supplémentaire,

- ni un exercice de conformité.

C’est la couche manquante nécessaire pour que les systèmes d’IA héritent du jugement organisationnel au lieu d’hériter simplement des sorties.

Car la vraie question de l’ère de l’IA n’est plus :

« Les machines peuvent-elles générer du logiciel ? »

Cette question reçoit déjà sa réponse.

La vraie question est :

« Comment préserver et transférer le jugement d’ingénierie une fois que la génération de logiciel devient bon marché ? »

Comment s’assurer que les futurs agents héritent non seulement de ce qui a été construit, mais aussi de pourquoi cela a été construit de cette manière ?

Comment préserver les compromis avant qu’ils ne se dissolvent dans le code généré ?

Comment empêcher les organisations de devenir des systèmes amnésiques opérés par des moteurs d’exécution de plus en plus capables ?

Et peut-être plus important encore :

Comment construire une intuition viscérale virtuelle sans transformer les systèmes d’IA en machines superstitieuses opaques ?

L’industrie est encore trop en avance pour voir le risque

Le défi, c’est que les conversations sur la gouvernance deviennent rarement dominantes pendant la phase d’expansion d’une vague technologique.

Elles deviennent dominantes après le premier effondrement de confiance à grande échelle.

Après le premier désastre évitable.

Après la première défaillance de raisonnement invisible aux conséquences visibles.

La réalité inconfortable, c’est que l’industrie de l’IA est actuellement en train de préparer des blocs opératoires à l’échelle industrielle tout en discutant à peine de la manière dont le jugement chirurgical lui-même survivra à l’automatisation.

Et au moment où les premiers grands échecs imposeront la conversation, les systèmes seront peut-être déjà profondément intégrés aux fondations de la manière dont les organisations pensent, construisent, décident et opèrent.

Pensée finale

Le moment de préserver le jugement, ce n’est pas après que la chirurgie commence à tuer des gens.

Le moment, c’est maintenant.