Nous apprenons à l’IA à décider. Mais nous oublions comment se souvenir.

Author: Yauheni Kurbayeu

Published: Jan 3, 2026

LinkedIn

Il y a quelque temps, j’ai écrit que « le SDLC n’a pas de mémoire ».

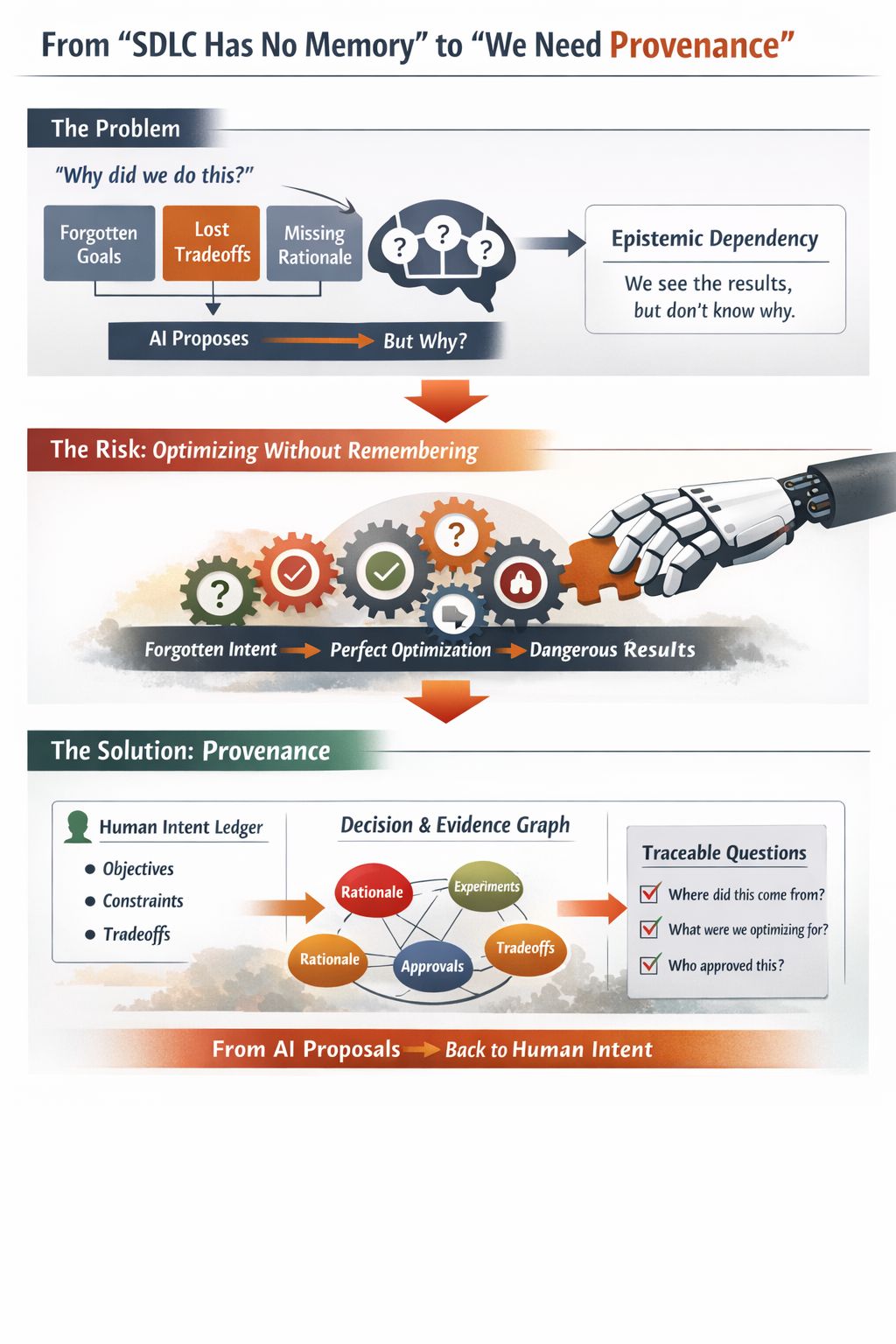

Nous ne nous souvenons pas pourquoi certaines décisions ont été prises, quels compromis ont été acceptés, ni quelles contraintes étaient explicites. Six mois plus tard, quelqu’un demande : « Pourquoi faisons-nous cela de cette façon ? »

Et la réponse honnête est souvent : « Nous ne le savons plus vraiment. Mais ça fonctionne. »

Jusqu’à récemment, ce n’était « qu’un » problème de delivery.

Aujourd’hui, cela devient un problème de sécurité de l’IA.

Nous commençons à laisser l’IA :

- proposer des architectures

- optimiser des plans

- explorer des espaces de solutions que les humains ne peuvent pas entièrement raisonner

Et nous basculons progressivement :

- de : « Nous comprenons pourquoi c’est la solution. »

- vers : « Le système a trouvé cela. Les métriques sont bonnes. »

Cela crée un écart de compréhension : nous voyons les résultats, mais nous ne comprenons plus le raisonnement.

Le véritable risque n’est pas une IA malveillante.

Le véritable risque est : « Nous construirons des systèmes qui optimisent parfaitement des choses que nous ne nous souvenons même plus avoir choisies. »

Aucune conscience nécessaire. Juste de l’optimisation, des boucles de rétroaction et une intention oubliée.

Ce qui manque, c’est une nouvelle couche d’infrastructure : la Provenance.

Provenance = la capacité de répondre à la question : « D’où vient cette décision et quelle intention humaine servait-elle ? »

Pas un wiki.

Pas Jira.

Pas Confluence.

Mais :

- Un registre de l’intention humaine

- Un graphe de décisions, de preuves et de compromis

- Une trace reliant l’exécution à l’objectif

Dans un monde où les machines proposent de plus en plus de décisions :

L’IA ne devrait pas être le juge.

La provenance devrait être le procès-verbal du tribunal.

Avant de parler d’« alignement de l’IA », nous devons être capables de prouver :

- Que cherchons-nous réellement à optimiser ?

- Quels sont les non-objectifs ?

- Quelles contraintes sont sacrées ?

- Quels compromis ont été explicitement acceptés ?

Sinon, nous obtiendrons un non-sens parfaitement optimisé.

Nous avons commencé avec un problème de delivery.

Nous terminons avec un problème de gouvernance et de sécurité à l’échelle de la civilisation :

Comment nous assurer que nous nous souvenons encore de ce que nous essayons de construire lorsque les machines commencent à le construire avec nous ?