Budujemy fabryki oprogramowania AI bez uczenia ich osądu

Author: Yauheni Kurbayeu

Published: May 13, 2026

LinkedIn

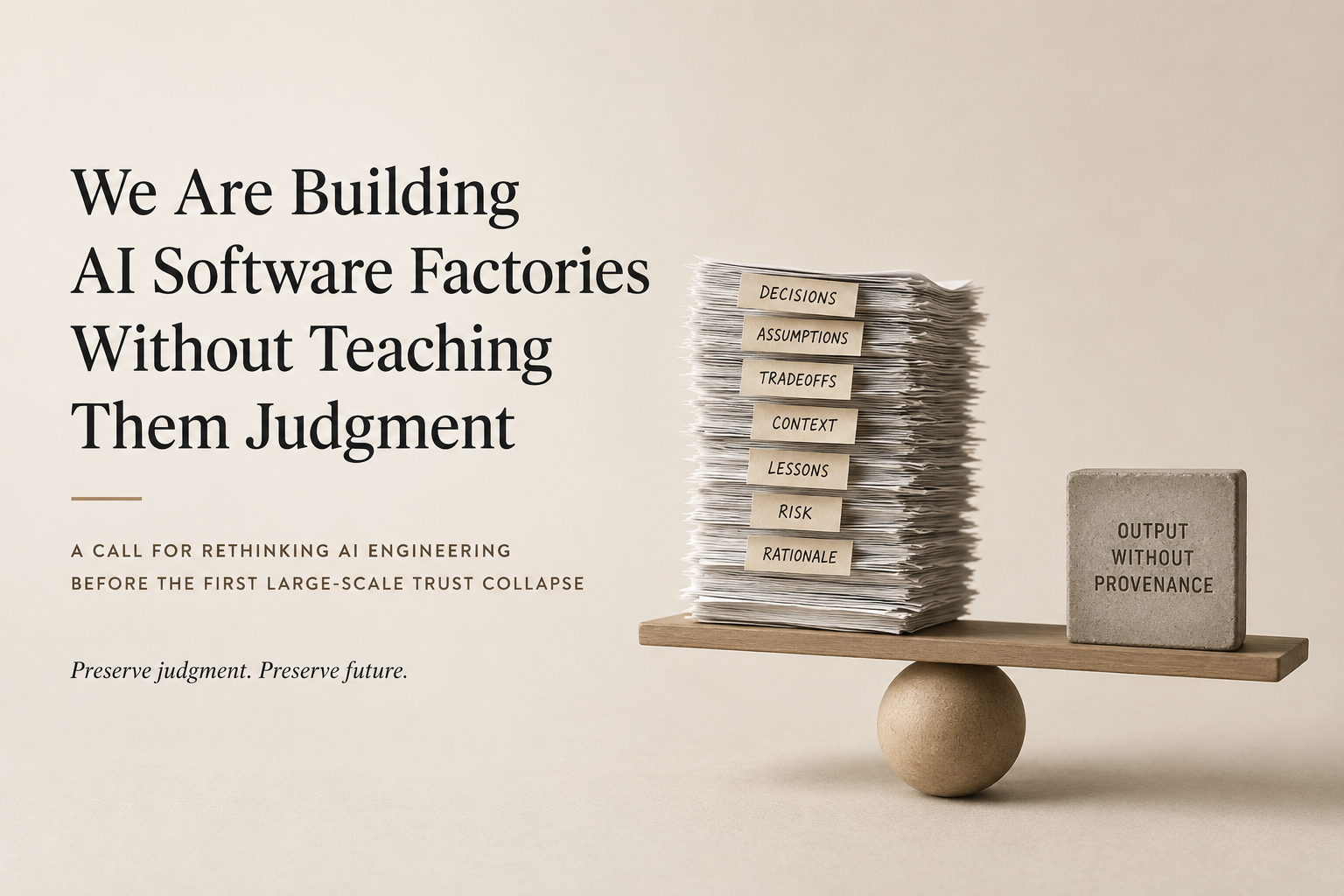

Wezwanie do przemyślenia inżynierii AI, zanim nastąpi pierwsze załamanie zaufania na dużą skalę

Branża świętuje dziwny kamień milowy.

W końcu nauczyliśmy maszyny wytwarzać oprogramowanie na przemysłową skalę.

Wieloagentowe systemy kodujące potrafią dziś:

- pisać funkcjonalności,

- refaktoryzować repozytoria,

- generować testy,

- przeglądać pull requesty,

- migrować frameworki,

- oraz orkiestrować pipeline’y dostarczania szybciej, niż wiele zespołów wyobrażało sobie to jeszcze zaledwie dwa lata temu.

A jednak prawie nikt nie zadaje niewygodnego pytania ukrytego pod całą tą akceleracją.

Kto uczy te systemy osądu?

Nie składni.

Nie orkiestracji.

Nie wydajności w benchmarkach.

Osądu.

Niebezpieczna analogia, o której nikt nie chce rozmawiać

Obecnie branża AI coraz bardziej przypomina szpital, który postanowił radykalnie zwiększyć przepustowość operacji, wręczając skalpele wybitnym absolwentom medycyny natychmiast po ukończeniu studiów.

Ci studenci mają:

- perfekcyjne wyniki egzaminów,

- bezbłędną wiedzę anatomiczną,

- znakomite wyniki w symulacjach,

- oraz pełną znajomość najlepszych praktyk proceduralnych.

Ale żaden doświadczony szpital na świecie nie pozwoliłby im samodzielnie przeprowadzać operacji serca od pierwszego dnia.

Dlaczego?

Ponieważ medycyna rozumie coś, co inżynieria oprogramowania wciąż próbuje ignorować:

Istnieje ogromna różnica między wiedzą, jak wykonać procedurę, a wiedzą, kiedy, dlaczego i w jakich warunkach ta procedura powinna zostać wykonana.

Tą różnicą jest skumulowany osąd.

A skumulowany osąd to w dużej mierze skompresowana historia decyzji.

Kliniczna intuicja to skompresowana proweniencja

Doświadczeni chirurdzy nie operują wyłącznie na podstawie podręczników.

Operują, opierając się na:

- tysiącach wcześniejszych decyzji,

- porażkach,

- kompromisach,

- sytuacjach bliskich błędu,

- powikłaniach,

- adaptacjach proceduralnych,

- oraz sygnałach kontekstowych gromadzonych przez lata.

To, co medycyna nazywa intuicją kliniczną, jest często silnie skompresowaną proweniencją decyzji.

Wirtualnym przeczuciem zbudowanym z zachowanych decyzji.

A jednak w inżynierii oprogramowania, szczególnie w erze AI, industrializujemy wykonanie, niemal całkowicie ignorując samo zachowanie osądu.

Branża ma obsesję na punkcie widocznej akceleracji

Obecna rozmowa o AI jest zdominowana przez:

- autonomicznych agentów,

- fabryki oprogramowania,

- frameworki orkiestracji,

- możliwości modeli,

- wzrost produktywności,

- szybkość kodowania,

- oraz redukcję kosztów.

Ale bardzo mało uwagi poświęca się niewidocznej warstwie znajdującej się pod wynikiem:

- dlaczego podjęto decyzje,

- jakie założenia je ukształtowały,

- jakie kompromisy zaakceptowano,

- które alternatywy odrzucono,

- czy pierwotne rozumowanie nadal jest aktualne,

- oraz w jaki sposób przyszłe systemy bezpiecznie dziedziczą te decyzje.

To pominięcie staje się niebezpieczne.

Pamięć organizacyjna po cichu zanika

Im bardziej zdolne stają się systemy AI, tym bardziej pamięć organizacyjna zaczyna po cichu znikać za wygenerowanymi wynikami.

Na początku problem jest subtelny.

Jeden agent AI wprowadza obejście, bo „kod działa”.

Inny agent później optymalizuje wokół tego obejścia, nie rozumiejąc jego pierwotnego ograniczenia.

Kilka miesięcy później trzeci system traktuje to obejście jako architektoniczną prawdę.

W końcu nikt już nie pamięta:

- czy to zachowanie było zamierzone,

- czy kompromis miał charakter tymczasowy,

- czy polityka się zmieniła,

- czy pierwotne ryzyko nadal istnieje,

- ani czy całe to rozumowanie nie wygasło już dawno temu.

System nadal działa.

Ale linia dziedziczenia osądu znika.

A gdy ta linia znika, organizacje zaczynają działać na odziedziczonych decyzjach, których nie potrafią już wyjaśnić.

Większość inżynierskiego osądu jest dziedziczona, a nie wyliczana od nowa

To jest część, którą wiele współczesnych dyskusji o AI niebezpiecznie lekceważy.

Ludzie zakładają, że wystarczająco zaawansowane systemy AI po prostu „przemyślą wszystko od nowa od zera”.

Ale starsi inżynierowie wiedzą, że prawdziwe systemy tak nie działają.

Organizacje działają na skompresowanym kontekście historycznym:

- przeszłych incydentach,

- bliznach produkcyjnych,

- ograniczeniach operacyjnych,

- kompromisach regulacyjnych,

- nieudanych migracjach,

- lekcjach skalowania,

- realiach politycznych,

- oraz pamięci instytucjonalnej.

Większość inżynierskiego osądu jest dziedziczona, a nie wyliczana od nowa.

To, co potocznie nazywamy „przeczuciem”, jest często latami nierozwiązanej proweniencji decyzji skompresowanej do intuicji.

Medycyna już rozwiązała ten problem kulturowo

Medycyna skaluje ekspertyzę poprzez:

- nadzorowaną praktykę,

- peer review,

- historie przypadków,

- pamięć instytucjonalną,

- linię proceduralnego dziedziczenia,

- granice dopuszczalności,

- oraz struktury odpowiedzialności.

Nie skaluje się poprzez udawanie, że intuicja jest zbędna.

Tymczasem inżynieria oprogramowania coraz częściej zachowuje się tak, jakby samo wykonanie wystarczało.

Jak gdyby:

- generowanie wyników, które wyglądają poprawnie, gwarantowało poprawne rozumowanie,

- lokalna optymalizacja automatycznie prowadziła do globalnie spójnych systemów,

- a pamięć organizacyjna mogła bezpiecznie wyparować, bo kolejna iteracja modelu „sama to rozgryzie”.

Skalujemy junior engineering

Fabryki oprogramowania bez zachowanego osądu nie są senior engineeringiem na skalę.

Są junior engineeringiem na skalę.

Szybkim junior engineeringiem.

Uprzemysłowionym junior engineeringiem.

A niebezpieczeństwo junior engineeringu nie polega na tym, że zawsze zawodzi natychmiast.

Niebezpieczeństwo polega na tym, że z przekonaniem odnosi sukces aż do momentu, gdy skumulowane niewidoczne błędy staną się systemowe.

Dlaczego proweniencja decyzji ma dziś znaczenie

Proweniencja decyzji nie jest:

- korporacyjnym teatrem governance,

- kolejnym dashboardem obserwowalności,

- ani ćwiczeniem compliance.

To brakująca warstwa potrzebna systemom AI do dziedziczenia organizacyjnego osądu zamiast samego dziedziczenia wyników.

Bo prawdziwe pytanie ery AI nie brzmi już:

„Czy maszyny potrafią generować oprogramowanie?”

Na to pytanie odpowiedź już się pojawia.

Prawdziwe pytanie brzmi:

„Jak zachować i przekazać inżynierski osąd, gdy generowanie oprogramowania staje się tanie?”

Jak sprawić, by przyszli agenci dziedziczyli nie tylko co zostało zbudowane, ale także dlaczego zostało zbudowane właśnie w ten sposób?

Jak zachować kompromisy, zanim rozpłyną się w wygenerowanym kodzie?

Jak zapobiec temu, by organizacje stały się systemami z amnezją, obsługiwanymi przez coraz sprawniejsze silniki wykonawcze?

I być może najważniejsze:

Jak zbudować wirtualne przeczucie, nie zamieniając systemów AI w nieprzejrzyste maszyny przesądów?

Branża jest wciąż na zbyt wczesnym etapie, by dostrzec ryzyko

Wyzwanie polega na tym, że rozmowy o governance rzadko stają się głównym nurtem w fazie ekspansji fali technologicznej.

Stają się głównym nurtem po pierwszym załamaniu zaufania na dużą skalę.

Po pierwszej katastrofie, której można było zapobiec.

Po pierwszej niewidocznej porażce rozumowania z widocznymi konsekwencjami.

Niewygodna rzeczywistość jest taka, że branża AI przygotowuje obecnie sale operacyjne na przemysłową skalę, ledwie dyskutując o tym, jak sam osąd chirurgiczny przetrwa automatyzację.

A zanim pierwsze duże porażki wymuszą tę rozmowę, systemy mogą już być głęboko wbudowane w fundamenty tego, jak organizacje myślą, budują, decydują i działają.

Myśl końcowa

Czas na zachowanie osądu nie przychodzi wtedy, gdy operacja zaczyna zabijać ludzi.

Czas jest teraz.