Мы учим ИИ принимать решения. Но забываем, как помнить.

Author: Yauheni Kurbayeu

Published: Jan 3, 2026

LinkedIn

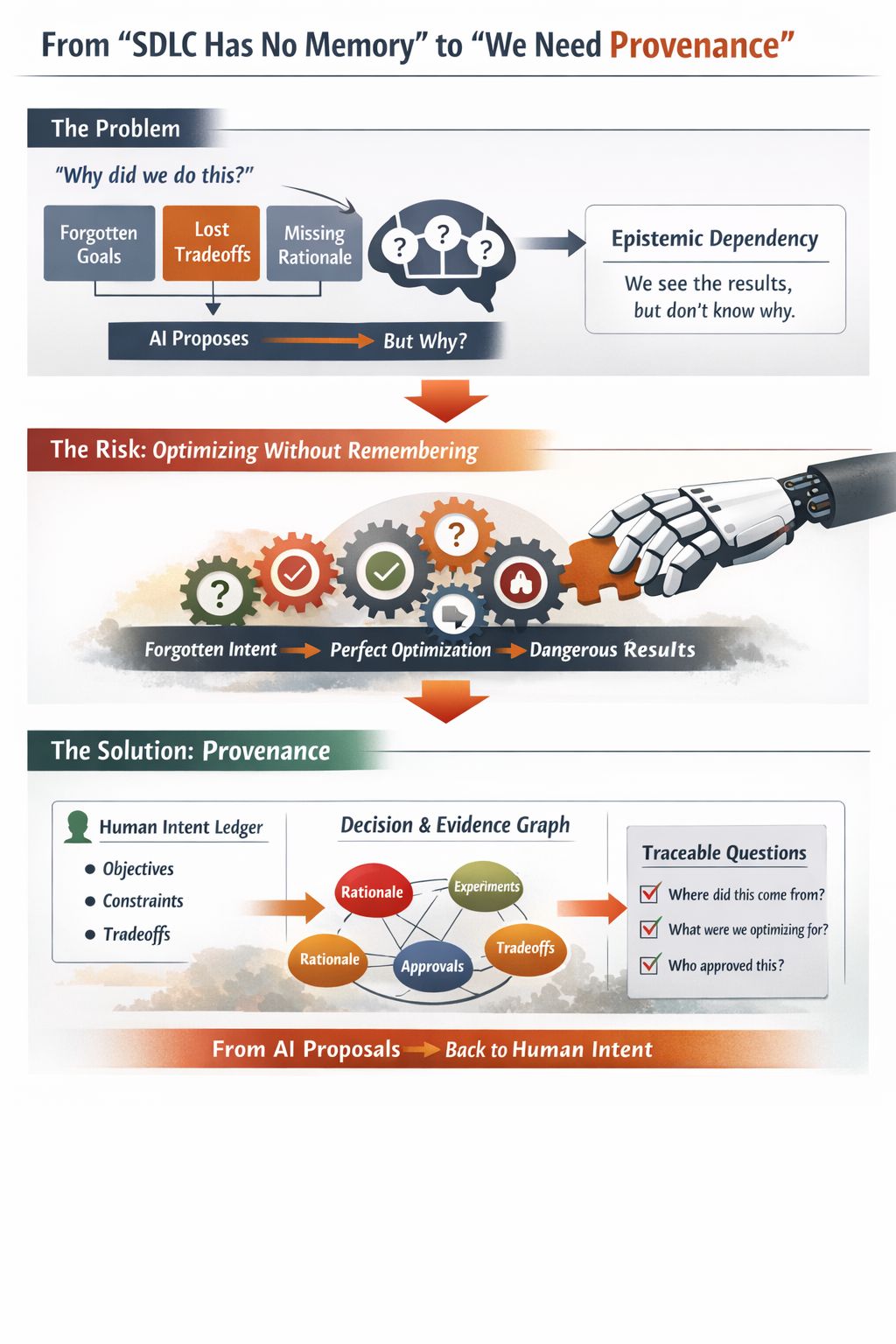

Некоторое время назад я написал, что «у SDLC нет памяти».

Мы не помним, почему были приняты те или иные решения, какие компромиссы были согласованы и какие ограничения были явно зафиксированы. Через шесть месяцев кто-то спрашивает: «Почему мы делаем это именно так?»

И честный ответ часто звучит так: «Мы уже не очень помним. Но это работает.»

До недавнего времени это было «всего лишь» проблемой delivery.

Теперь это начинает превращаться в проблему безопасности ИИ.

Мы начинаем позволять ИИ:

- предлагать архитектуры

- оптимизировать планы

- исследовать пространства решений, которые люди не способны полностью осмыслить

И постепенно происходит сдвиг:

- от: «Мы понимаем, почему это решение выбрано.»

- к: «Система это нашла. Метрики выглядят хорошо.»

Это создаёт разрыв понимания: мы видим результаты, но уже не понимаем ход рассуждений.

Реальный риск — это не злой ИИ.

Реальный риск в том, что «мы будем строить системы, которые идеально оптимизируют то, выбор чего мы уже даже не помним.»

Никакого сознания не требуется. Только оптимизация, петли обратной связи и забытое намерение.

Чего не хватает — это нового инфраструктурного слоя: Provenance.

Provenance = способность ответить на вопрос: «Откуда взялось это решение и какому человеческому намерению оно служило?»

Не wiki.

Не Jira.

Не Confluence.

А скорее:

- Реестр человеческих намерений

- Граф решений, доказательств и компромиссов

- Трассировка от исполнения обратно к цели

В мире, где машины предлагают всё больше решений:

ИИ не должен быть судьёй.

Provenance должна быть судебным протоколом.

Прежде чем говорить о «выравнивании ИИ», мы должны уметь доказать:

- Что именно мы пытаемся оптимизировать?

- Какие есть не-цели?

- Какие ограничения являются священными?

- Какие компромиссы были явно приняты?

Иначе мы получим идеально оптимизированную бессмыслицу.

Мы начали с проблемы delivery.

Мы заканчиваем проблемой управления и безопасности масштаба цивилизации:

Как убедиться, что мы всё ещё помним, что именно пытаемся построить, когда машины начинают строить это вместе с нами?