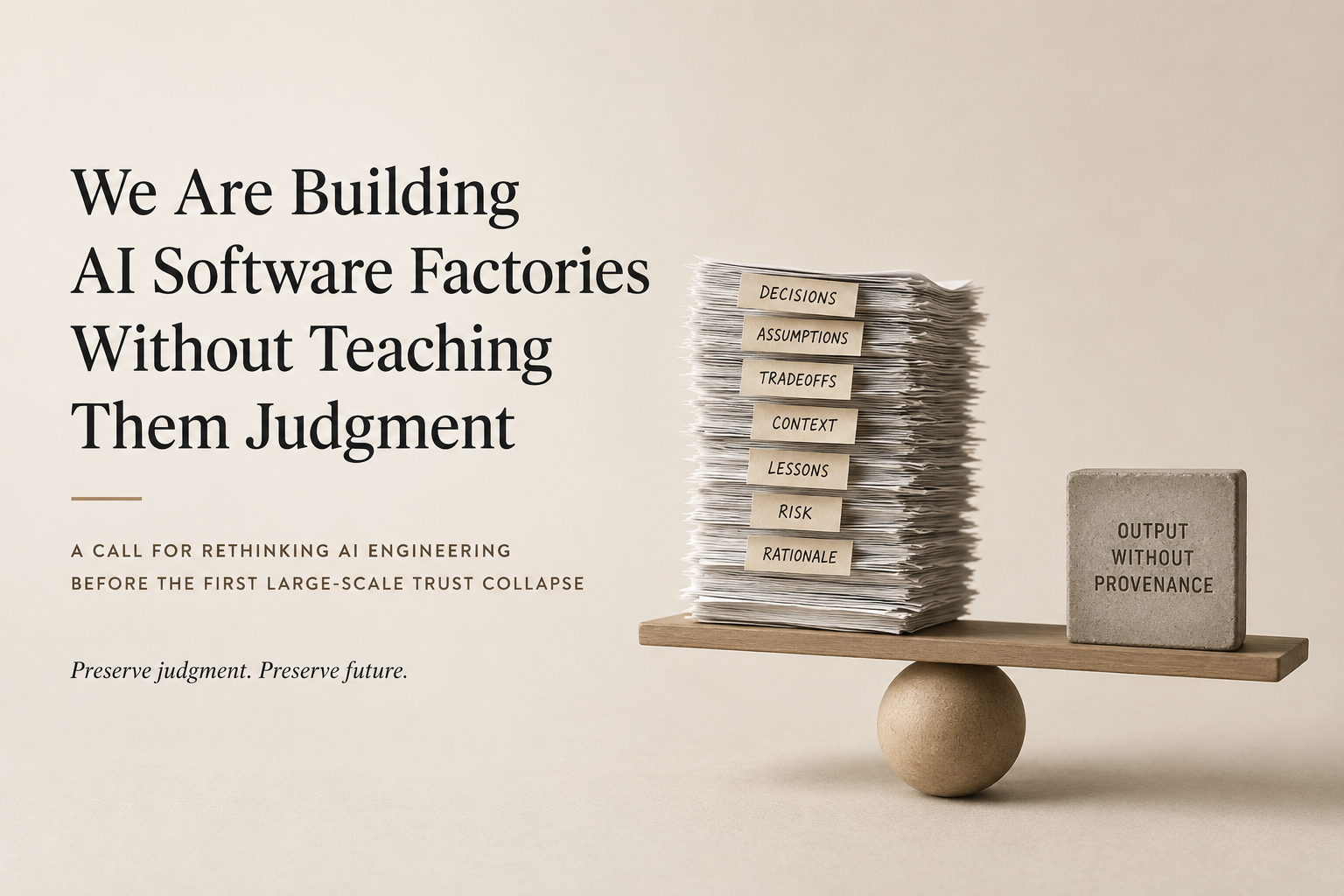

Wir bauen KI-Softwarefabriken, ohne ihnen Urteilsvermögen beizubringen

Author: Yauheni Kurbayeu

Published: May 13, 2026

LinkedIn

Ein Aufruf, KI-Engineering neu zu denken, bevor der erste großflächige Vertrauenskollaps eintritt

Die Branche feiert einen seltsamen Meilenstein.

Wir haben Maschinen endlich beigebracht, Software im industriellen Maßstab zu produzieren.

Multi-Agenten-Coding-Systeme können heute:

- Features schreiben,

- Repositories refaktorieren,

- Tests generieren,

- Pull Requests prüfen,

- Frameworks migrieren,

- und Delivery-Pipelines schneller orchestrieren, als viele Teams es sich noch vor nur zwei Jahren vorstellen konnten.

Und fast niemand stellt die unbequeme Frage, die sich unter all dieser Beschleunigung verbirgt.

Wer bringt diesen Systemen Urteilsvermögen bei?

Nicht Syntax.

Nicht Orchestrierung.

Nicht Benchmark-Performance.

Urteilsvermögen.

Die gefährliche Analogie, über die niemand sprechen will

Im Moment ähnelt die KI-Industrie zunehmend einem Krankenhaus, das beschlossen hat, den Operationsdurchsatz massiv zu beschleunigen, indem es brillanten Medizinstudienabsolventen unmittelbar nach dem Universitätsabschluss Skalpelle in die Hand drückt.

Die Studierenden haben:

- perfekte Prüfungsergebnisse,

- makellose anatomische Kenntnisse,

- hervorragende Leistungen in Simulationen,

- und vollständige Kenntnis verfahrenstechnischer Best Practices.

Doch kein erfahrenes Krankenhaus der Welt würde ihnen erlauben, am ersten Tag eigenständig eine Herzoperation durchzuführen.

Warum?

Weil die Medizin etwas versteht, das das Software-Engineering noch immer zu ignorieren versucht:

Es gibt einen gewaltigen Unterschied zwischen dem Wissen, wie man ein Verfahren ausführt, und dem Wissen, wann, warum und unter welchen Bedingungen dieses Verfahren stattfinden sollte.

Dieser Unterschied ist angesammeltes Urteilsvermögen.

Und angesammeltes Urteilsvermögen ist größtenteils komprimierte Entscheidungshistorie.

Klinische Intuition ist komprimierte Provenienz

Erfahrene Chirurgen operieren nicht ausschließlich nach Lehrbüchern.

Sie handeln auf Basis von:

- tausenden früheren Entscheidungen,

- Fehlschlägen,

- Trade-offs,

- Beinahefehlern,

- Komplikationen,

- prozeduralen Anpassungen,

- und kontextuellen Signalen, die sich über Jahre angesammelt haben.

Was die Medizin klinische Intuition nennt, ist oft hochgradig komprimierte Entscheidungs-Provenienz.

Ein virtuelles Bauchgefühl, aufgebaut aus bewahrten Entscheidungen.

Doch im Software-Engineering, besonders im KI-Zeitalter, industrialisieren wir die Ausführung, während wir die Bewahrung des Urteilsvermögens selbst fast vollständig ignorieren.

Die Branche ist von sichtbarer Beschleunigung besessen

Die aktuelle KI-Debatte wird dominiert von:

- autonomen Agenten,

- Softwarefabriken,

- Orchestrierungs-Frameworks,

- Modellfähigkeiten,

- Produktivitätsgewinnen,

- Coding-Geschwindigkeit,

- und Kostenreduktion.

Doch der unsichtbaren Schicht unterhalb des Outputs wird viel zu wenig Aufmerksamkeit geschenkt:

- warum Entscheidungen getroffen wurden,

- welche Annahmen sie geprägt haben,

- welche Trade-offs akzeptiert wurden,

- welche Alternativen verworfen wurden,

- ob die ursprüngliche Begründung noch gültig ist,

- und wie zukünftige Systeme diese Entscheidungen sicher erben.

Diese Auslassung wird gefährlich.

Organisationales Gedächtnis verschwindet still und leise

Je leistungsfähiger KI-Systeme werden, desto mehr beginnt organisatorisches Gedächtnis stillschweigend hinter generierten Outputs zu verschwinden.

Das Problem ist anfangs subtil.

Ein KI-Agent führt eine Umgehungslösung ein, weil „der Code funktioniert“.

Ein anderer Agent optimiert später rund um diese Umgehungslösung, ohne deren ursprüngliche Einschränkung zu verstehen.

Monate später behandelt ein drittes System die Umgehungslösung als architektonische Wahrheit.

Am Ende erinnert sich niemand mehr:

- ob das Verhalten beabsichtigt war,

- ob der Trade-off nur vorübergehend war,

- ob sich die Richtlinie geändert hat,

- ob das ursprüngliche Risiko noch existiert,

- oder ob die gesamte Begründung längst abgelaufen ist.

Das System funktioniert noch.

Aber die Urteils-Lineage ist verschwunden.

Und sobald diese Lineage verschwindet, beginnen Organisationen auf vererbten Entscheidungen zu operieren, die sie nicht mehr erklären können.

Der größte Teil technischen Urteilsvermögens wird vererbt, nicht neu berechnet

Das ist der Teil, den viele aktuelle KI-Diskussionen gefährlich unterschätzen.

Menschen nehmen an, hinreichend fortgeschrittene KI-Systeme würden einfach „alles erneut von Grund auf durchdenken“.

Doch Senior Engineers wissen, dass reale Systeme nicht so funktionieren.

Organisationen laufen auf komprimiertem historischem Kontext:

- vergangenen Vorfällen,

- Narben aus der Produktion,

- operativen Einschränkungen,

- regulatorischen Kompromissen,

- gescheiterten Migrationen,

- Skalierungslektionen,

- politischen Realitäten,

- und institutionellem Gedächtnis.

Der größte Teil technischen Urteilsvermögens wird vererbt, nicht neu berechnet.

Was wir beiläufig „Bauchgefühl“ nennen, sind oft Jahre ungelöster Entscheidungs-Provenienz, komprimiert zu Intuition.

Die Medizin hat dieses Problem kulturell bereits gelöst

Die Medizin skaliert Expertise durch:

- beaufsichtigte Praxis,

- Peer Review,

- Fallhistorien,

- institutionelles Gedächtnis,

- prozedurale Lineage,

- Grenzen der Zulässigkeit,

- und Verantwortungsstrukturen.

Sie skaliert nicht, indem sie so tut, als sei Intuition unnötig.

Das Software-Engineering verhält sich derweil zunehmend so, als reiche Ausführung allein aus.

Als ob:

- das Generieren korrekt aussehender Outputs korrekte Begründung garantiere,

- lokale Optimierung automatisch global kohärente Systeme hervorbringe,

- und organisatorisches Gedächtnis gefahrlos verdampfen könne, weil die nächste Modelliteration es schon „herausfinden“ werde.

Wir skalieren Junior Engineering

Softwarefabriken ohne bewahrtes Urteilsvermögen sind kein Senior Engineering im Maßstab.

Sie sind Junior Engineering im Maßstab.

Schnelles Junior Engineering.

Industrialisiertes Junior Engineering.

Und die Gefahr von Junior Engineering besteht nicht darin, dass es immer sofort scheitert.

Die Gefahr besteht darin, dass es selbstbewusst erfolgreich ist – genau so lange, bis die angesammelten unsichtbaren Fehler systemisch werden.

Warum Entscheidungs-Provenienz jetzt wichtig ist

Entscheidungs-Provenienz ist nicht:

- Theater der Corporate Governance,

- ein weiteres Observability-Dashboard,

- oder eine Compliance-Übung.

Sie ist die fehlende Schicht, die KI-Systeme benötigen, um organisatorisches Urteilsvermögen zu erben, statt lediglich Outputs zu erben.

Denn die eigentliche Frage des KI-Zeitalters lautet nicht mehr:

„Können Maschinen Software generieren?“

Diese Frage wird bereits beantwortet.

Die eigentliche Frage lautet:

„Wie bewahren und übertragen wir technisches Urteilsvermögen, sobald die Generierung von Software billig wird?“

Wie stellen wir sicher, dass zukünftige Agenten nicht nur was gebaut wurde erben, sondern auch warum es auf diese Weise gebaut wurde?

Wie bewahren wir Trade-offs, bevor sie sich im generierten Code auflösen?

Wie verhindern wir, dass Organisationen zu amnestischen Systemen werden, die von immer leistungsfähigeren Ausführungsmaschinen betrieben werden?

Und vielleicht am wichtigsten:

Wie bauen wir ein virtuelles Bauchgefühl auf, ohne KI-Systeme in opake Aberglaubensmaschinen zu verwandeln?

Die Branche ist noch zu früh, um das Risiko zu erkennen

Die Herausforderung besteht darin, dass Governance-Debatten während der Expansionsphase einer technologischen Welle selten Mainstream werden.

Sie werden erst nach dem ersten großflächigen Vertrauenskollaps Mainstream.

Nach der ersten vermeidbaren Katastrophe.

Nach dem ersten unsichtbaren Begründungsfehler mit sichtbaren Folgen.

Die unbequeme Realität ist, dass die KI-Industrie derzeit Operationssäle im industriellen Maßstab vorbereitet, während sie kaum darüber spricht, wie das chirurgische Urteilsvermögen selbst die Automatisierung überleben soll.

Und bis die ersten großen Fehlschläge die Debatte erzwingen, könnten diese Systeme bereits tief in die Grundlagen dessen eingebettet sein, wie Organisationen denken, bauen, entscheiden und operieren.

Abschließender Gedanke

Der richtige Zeitpunkt, Urteilsvermögen zu bewahren, ist nicht erst dann, wenn die Operation Menschen zu töten beginnt.

Der richtige Zeitpunkt ist jetzt.