Wir bringen KI bei zu entscheiden. Aber wir vergessen, wie man sich erinnert.

Author: Yauheni Kurbayeu

Published: Jan 3, 2026

LinkedIn

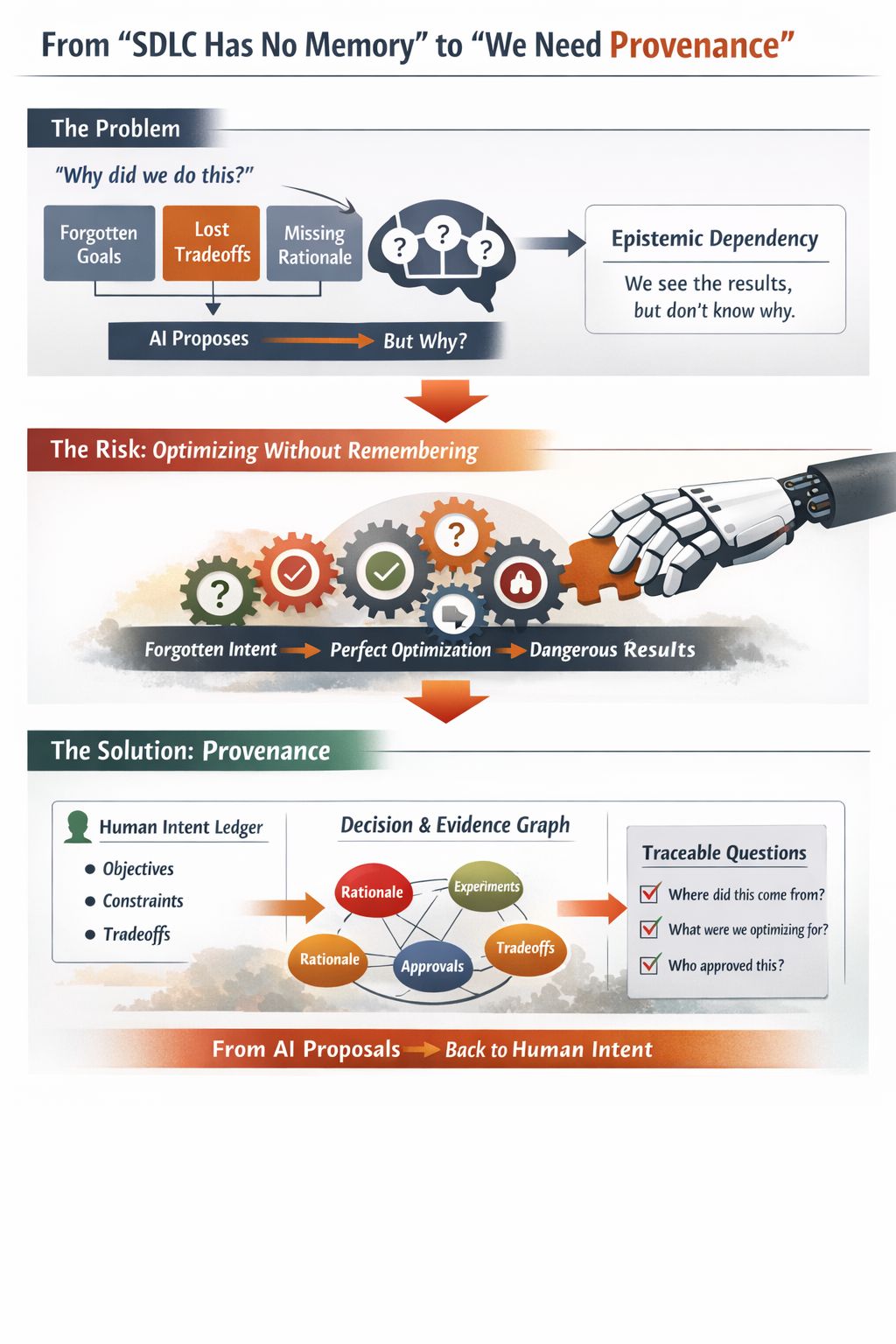

Vor einiger Zeit habe ich geschrieben, dass „SDLC kein Gedächtnis hat“.

Wir erinnern uns nicht mehr, warum Entscheidungen getroffen wurden, welche Kompromisse akzeptiert wurden oder welche Einschränkungen ausdrücklich festgelegt waren. Sechs Monate später fragt jemand: „Warum machen wir das eigentlich so?“

Und die ehrliche Antwort lautet oft: „Wir wissen es eigentlich nicht mehr. Aber es funktioniert.“

Bis vor Kurzem war das „nur“ ein Delivery-Problem.

Jetzt wird es zu einem KI-Sicherheitsproblem.

Wir beginnen, KI zuzulassen, dass sie:

- Architekturen vorschlägt

- Pläne optimiert

- Lösungsräume erkundet, die Menschen nicht vollständig durchdenken können

Und wir verschieben uns langsam:

- von: „Wir verstehen, warum das die Lösung ist.“

- zu: „Das System hat das gefunden. Die Metriken sehen gut aus.“

Das schafft eine Verständnislücke: Wir sehen die Ergebnisse, aber wir verstehen die zugrunde liegende Begründung nicht mehr.

Das eigentliche Risiko ist keine böse KI.

Das eigentliche Risiko ist: „Wir werden Systeme bauen, die perfekt Dinge optimieren, von denen wir nicht mehr wissen, dass wir sie jemals gewählt haben.“

Kein Bewusstsein erforderlich. Nur Optimierung, Feedback-Schleifen und vergessene Absicht.

Was fehlt, ist eine neue Infrastruktur-Schicht: Provenance.

Provenance = die Fähigkeit, die Frage zu beantworten: „Woher stammt diese Entscheidung und welcher menschlichen Absicht diente sie?“

Kein Wiki.

Kein Jira.

Kein Confluence.

Sondern:

- Ein Ledger menschlicher Absichten

- Ein Graph von Entscheidungen, Belegen und Trade-offs

- Eine Spur von der Ausführung zurück zum Zweck

In einer Welt, in der Maschinen immer mehr Entscheidungen vorschlagen:

Die KI sollte nicht der Richter sein.

Provenance sollte das Gerichtsprotokoll sein.

Bevor wir über „AI Alignment“ sprechen, müssen wir nachweisen können:

- Was versuchen wir eigentlich zu optimieren?

- Was sind die Nicht-Ziele?

- Welche Einschränkungen sind unantastbar?

- Welche Trade-offs wurden ausdrücklich akzeptiert?

Sonst bekommen wir perfekt optimierten Unsinn.

Wir haben mit einem Delivery-Problem begonnen.

Wir enden bei einem Governance- und zivilisationsweiten Sicherheitsproblem:

Wie stellen wir sicher, dass wir uns noch erinnern, was wir eigentlich bauen wollten, wenn Maschinen beginnen, es gemeinsam mit uns zu bauen?